1 standalone模式

1.1 安装

解压缩 flink-1.7.0-bin-hadoop27-scala_2.11.tgz

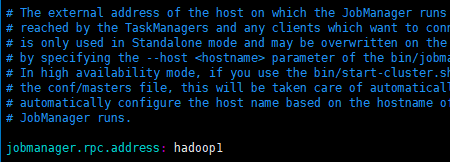

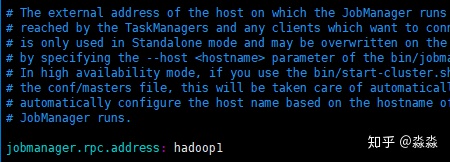

修改 flink/conf/flink-conf.yaml 文件

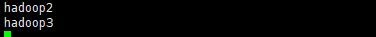

修改 /conf/slave文件

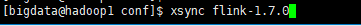

.分发给 另外两台机子

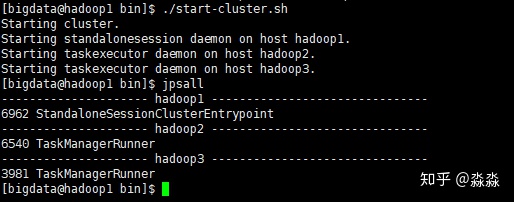

启动

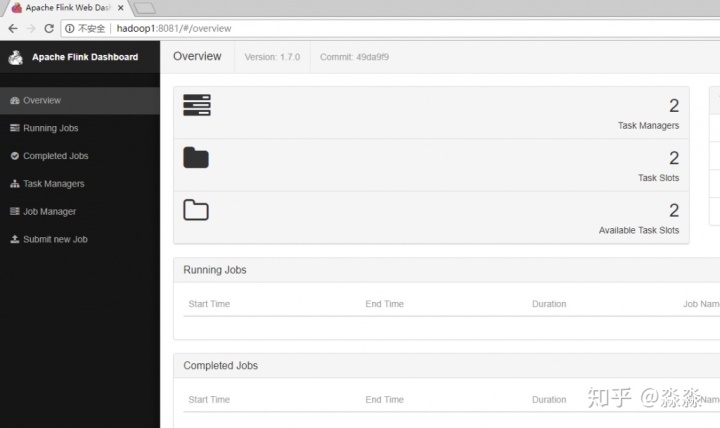

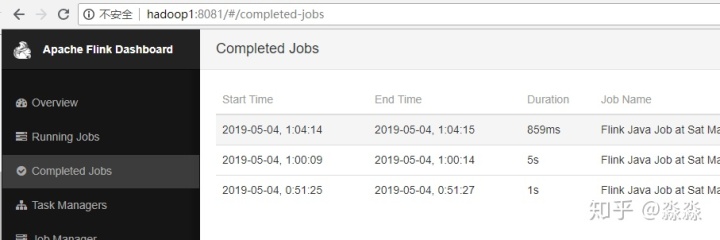

访问http://hadoop1:8081

1.2 提交任务

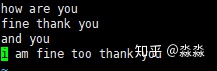

1) 准备数据文件

2) 把含数据文件的文件夹,分发到taskmanage 机器中

由于读取数据是从本地磁盘读取,实际任务会被分发到taskmanage的机器中,所以要把目标文件分发。

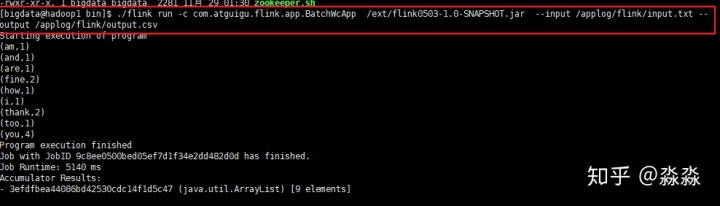

3) 执行程序

./flink run -c com.atguigu.flink.app.BatchWcApp /ext/flink0503-1.0-SNAPSHOT.jar –input /applog/flink/input.txt –output /applog/flink/output.csv

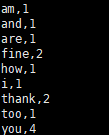

4) 到目标文件夹中查看计算结果

注意:计算结果根据会保存到taskmanage的机器下,不会再jobmanage下。

5) 在webui控制台查看计算过程

文章来源:大数据培训

大数据培训课程之Flink部署 - 技术聚焦 - 尚硅谷www.atguigu.com